本文是面向AI的多模态数据治理的最后一篇。

第一章 执行体系总览

1.1执行体系阶段划分与核心逻辑

1.1.1阶段划分

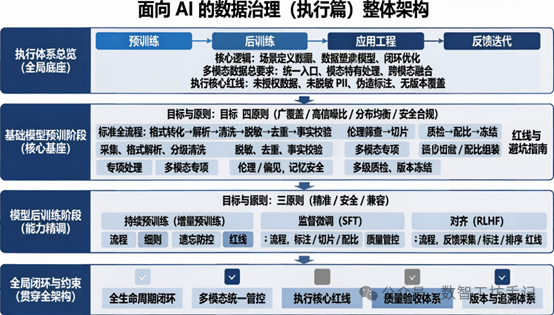

按AI模型全生命周期,数据治理执行体系分为四大核心阶段,形成完整闭环:预训练 → 后训练(增量预训练/SFT/对齐)→ 应用工程(RAG/Agent) → 反馈迭代

1.1.2核心逻辑

核心逻辑主要包含三点:一是场景定义数据,各场景的数据处理动作,必须严格服务于该场景的模型学习目标,杜绝无目的数据处理;二是数据塑造模型,数据的分布合理性、质量高低,直接决定模型的能力边界与落地效果,是模型性能的核心支撑;三是闭环优化,基于模型实际落地效果的反馈,持续迭代优化数据处理策略,形成“数据-模型-反馈-数据”的正向循环。

1.1.3闭环要求

闭环执行需满足三项要求:首先是全链路追溯,任何一个环节出现效果未达标等失败情况,必须触发对上游所有数据环节的复盘与针对性修正;其次是Badcase溯源,要建立完善的Badcase与数据问题的对应追溯机制,明确问题根源,比如数据质量不达标、分布存在偏差等;最后是效率优化,需定期回顾闭环执行效率,优化各环节衔接流程,降低治理成本的同时提升迭代速度。

1.2多模态数据处理总要求

为保障多模态模型的统一性与兼容性,数据处理需遵循以下刚性要求,结合行业标准制定明确验收标准,具体要求如下:在统一入口方面,需建立多模态数据湖,实现文本、图像、音频、视频流的统一接入与管理,打破模态数据壁垒,对应的验收标准为各类模态数据接入率100%,无任何遗漏;在模态特有处理方面,要尊重各模态的物理特性与数据特点,针对不同模态采用专用预处理算法,避免“一刀切”的处理方式,验收标准为各模态数据预处理后质量达标,能够满足后续训练与应用需求;在跨模态融合方面,需在数据切片与标注阶段,强制执行跨模态语义对齐校验,确保不同模态数据的语义一致性,验收标准为跨模态语义一致性不低于85%,该指标参考行业团体标准量化要求。

1.3执行核心红线

为保障数据合规性、模型安全性,明确以下不可触碰的核心红线,违规行为将触发对应处罚机制,具体内容如下:红线1为严禁使用未获授权的商业数据训练商用模型,违反该红线将引发法律纠纷、导致模型下架、遭受企业合规处罚,同时损害品牌声誉,对应的检测方式为定期开展授权台账核查,确保每批数据授权完整;红线2为严禁在未脱敏的情况下,将包含PII(个人身份信息)的数据投入训练,违反后会造成用户隐私泄露,触发监管处罚,企业需承担民事责任,检测方式为开展全量数据脱敏率扫描,确保敏感信息无遗漏;红线3为严禁为追求指标好看,人为伪造标注数据或篡改数据标签,此举会导致模型能力虚假,落地效果不达预期,浪费训练资源,检测方式为定期开展标注一致性抽检,抽检比例不低于5%;红线4为严禁在无版本控制的情况下,直接覆盖生产环境数据集,违反后会导致数据问题无法追溯、模型效果无法复现,增加故障排查成本,检测方式为开展版本管理审计,核查数据集更新的合规性。

第二章 基础模型预训练阶段数据治理与处理执行规范

2.1阶段核心目标与处理总原则

2.1.1核心目标

预训练阶段的核心目标有三点:一是构建海量、多样、高质量的通用语料库,为模型奠定坚实的基础能力;二是赋予模型基础语言理解能力、通用世界知识与初步逻辑推理潜能;三是保障预训练数据的合规性、安全性,规避后续模型应用过程中的各类风险。

2.1.2处理总原则

该阶段数据处理需遵循四项总原则,分别是广覆盖(Coverage)、高信噪比(SNR)、分布均衡(Balance)和安全合规(Safety)。其中,广覆盖要求领域、语言、模态全面覆盖,避免数据偏斜,以此支撑模型的通用能力;高信噪比要求有效内容占比高,严格剔除噪声数据,提升数据利用效率;分布均衡要求各维度数据分布合理,无严重偏斜,避免模型能力出现“偏科”情况;安全合规要求数据采集、处理全流程合规,无违规内容、无隐私泄露风险,符合行业标准要求。

2.2本阶段核心数据处理全流程

预训练阶段数据处理需遵循标准化流程,各环节衔接有序,形成“采集-处理-校验-冻结”的完整链路,具体流程为:合规采集 → 格式转化 → 文档解析 → 粗清洗 → 全量脱敏 → 粗去重 → 精细化清洗 → 精准去重 → 事实校验 → 伦理/偏见筛查 →语义切片→ 质检 → 分布配比 → 合库冻结。

流程说明

流程执行过程中需注意三点:一是标准化管控,每个环节需制定明确的输入输出标准,确保处理过程可量化、可追溯;二是日志留存,每个环节需详细记录执行日志,包括操作人、操作时间、处理参数、处理结果等关键信息;三是质量卡点,在脱敏、去重、事实校验、质检等关键节点需设置质量检查点,未达标数据不得进入下一环节。

2.3各处理动作执行细则与预训练专属要求

2.3.1采集环节:准入标准、合规要求与多模态规范

采集环节是数据质量的源头,需严格把控数据源准入与采集合规性,同时结合多模态特性制定专属规范。

(1)准入标准

准入标准明确要求:建立域名白名单制度,优先采集维基百科、arXiv、GitHub、权威新闻网站等高信源数据,确保数据可信度;单源数据占比不得超过30%,避免单一来源依赖,降低数据投毒与偏斜风险;严禁采集已知存在版权争议、内容质量低下或违规违法的网站数据。

(2)合规采集要求

合规采集需遵循三项要求:严格遵守Robots协议,不得违规爬取未授权数据;保留完整的网页快照,以备版权核查与纠纷处理;详细记录采集元数据,包括URL、采集时间、数据来源、操作人等,确保整个采集过程可追溯。

(3)多模态素材采集规范

针对不同模态素材,采集规范各有不同:图像数据需过滤低分辨率(<224x224)、含水印、模糊不清的图片,确保图像质量;代码数据需过滤非开源协议项目,优先采集开源合规的代码资源;音视频数据需确保版权清晰,过滤杂音、画质模糊的音视频素材,同时规范采样标准。

(4)验收指标

采集环节的验收指标包括三项:来源合规率100%,无违规采集数据;数据授权完整率100%,无未授权数据混入;单源数据占比<30%,符合多源分布要求。

2.3.2格式转化与解析环节:标准化与结构化要求

该环节的核心目标是实现多模态数据格式统一,保留原始文档结构,剔除无效版式噪声,为后续处理奠定基础。

(1)格式统一标准

不同类型数据的格式统一标准明确:文本数据统一转为UTF-8纯文本或JSONL格式,确保编码一致,无乱码;图像数据统一为JPEG/PNG格式,分辨率进行标准化处理,确保尺寸统一;音频数据统一为WAV/MP3格式,采样率标准化,剔除杂音干扰。

(2)文档结构保留要求

文档结构保留有明确要求:PDF解析时,必须保留标题层级、列表、表格结构,采用Markdown或特殊Token标记,严禁转为纯平文本导致结构丢失;表格数据需转换为Markdown表格或HTML等结构化格式,确保数据可读取、可复用。

(3)版式信息处理规范

版式信息处理需遵循三项规范:一是噪声剔除,移除页眉页脚、页码、广告横幅等无关噪声内容,提升数据纯度;二是价值保留,保留引用文献、脚注、附录等有价值内容,丰富数据维度;三是代码块处理,保留代码缩进与语法高亮标记,确保代码完整性与可读性。

(4)验收指标

本环节验收指标为:格式统一率100%,无格式混乱数据;文档结构保留率>95%,核心结构无丢失;版式噪声剔除率>90%,无效内容得到有效清理。

2.3.3清洗环节:分级清洗与边界样本保护

清洗环节采用“粗清洗+精细化清洗”的分级策略,在剔除低质数据的同时,防控过度清洗,保留边界/反例样本,增强模型鲁棒性。

(1)粗清洗执行标准

粗清洗需严格遵循以下标准:剔除长度过短(<50字)的无效文档,避免无意义数据占用资源;剔除乱码率>5%的文档,确保文本可读性;剔除外语混杂率过高的文档,避免语言干扰。

(2)精细化清洗执行标准

精细化清洗的执行标准为:利用启发式规则与分类模型,精准剔除SEO垃圾、机器生成文本、重复模板内容等低质数据;保留语义完整但稍显粗糙的内容,避免过度清洗导致数据价值流失。

(3)低质内容剔除规则

低质内容剔除有明确规则:广告内容占比>30%的文档,直接剔除;重复内容占比>80%的文档,直接剔除;无意义内容(如纯符号、乱码组合),直接剔除。

(4)过度清洗防控红线

过度清洗防控有三条不可触碰的红线:严禁剔除包含复杂逻辑、少量拼写错误但语义清晰的文本,避免模型失去复杂场景处理能力;严禁剔除作为负样本的边界案例,为模型构建认知边界;需保留约1%-5%的“非完美”数据,增强模型鲁棒性,适配真实场景的多样化输入。

(5)边界/反例样本保留要求

边界/反例样本保留需满足三项要求:精准识别并单独标记边界样本,明确样本属性;边界样本不参与常规清洗流程,避免被误剔除;边界样本转入专项样本库,用于后续模型边界能力优化。

(6)验收指标

清洗环节的验收指标为:低质内容剔除率>90%,低质数据得到有效清理;边界样本保留率100%,无边界样本误剔除;过度清洗违规率0%,严格遵循防控红线。

2.3.4脱敏环节:全量覆盖与记忆泄露防控

脱敏环节的核心目标是实现全量敏感信息识别与脱敏,前置防控记忆泄露风险,保障数据隐私安全,符合合规要求。

(1)敏感信息识别标准

敏感信息识别需覆盖全球主要国家的PII类型,包括身份证号、护照号、社保号、银行卡号、手机号、邮箱、住址等,同时要求敏感信息识别准确率>99%,召回率>99%,确保无遗漏。

(2)脱敏执行规范

脱敏执行采用“掩码+泛化”的双重策略,兼顾隐私保护与语义完整性。其中,实体级脱敏要求将具体个人信息替换为通用标记,例如将“张三”替换为[PERSON],将“北京市”替换为[CITY],同时保留实体类型信息,确保脱敏后文本语义连贯,不影响模型学习。

(3)记忆泄露前置防控要求

记忆泄露前置防控有三项要求:数据入库前进行二次敏感信息扫描,确保无漏网之鱼;高风险数据(如医疗记录、金融数据)额外增加人工审查环节,强化防控;建立敏感数据黑名单,明确禁止入库的敏感数据类型,从源头防控风险。

(4)验收指标

脱敏环节的验收指标为:敏感信息检出率>99%,无未识别的敏感信息;脱敏率>99.9%,敏感信息全部完成脱敏处理;记忆泄露风险评级达标,无记忆泄露隐患。

2.3.5去重环节:双机制管控与重复率红线

去重环节采用“精确去重+语义去重”的双机制,剔除重复与同质化数据,控制整体重复率,提升数据利用效率。

(1)精确去重执行标准

精确去重基于MD5/SHA256哈希值,精准剔除完全重复的文档,精确去重后,重复率目标<1%。

(2)语义去重执行标准

语义去重采用MinHash/LSH或Embedding聚类算法,识别近似重复内容,具体要求剔除Jaccard相似度>0.8或余弦相似度>0.9的近似重复内容,语义去重后,重复率目标<5%。

(3)同质化内容识别规则

同质化内容识别需遵循两项规则:识别并合并内容高度相似的镜像站点数据,避免数据冗余;优先保留质量最高、信源最权威的版本,提升数据质量。

(4)重复率管控红线

重复率管控有两条红线:最终语料库的整体重复率控制在5%以内,杜绝大量重复数据;单文档重复出现次数不超过3次,避免数据过度冗余。

(5)验收指标

去重环节的验收指标为:精确去重率100%,完全重复数据全部剔除;语义去重完成率100%,近似重复数据全部处理;整体重复率<5%,符合管控要求。

2.3.6事实校验环节:交叉验证与专家终审

事实校验环节的核心目的是确保预训练数据的事实准确性,剔除错误内容,对高风险领域数据实行专家终审,保障模型知识的正确性。

(1)交叉验证标准

交叉验证需针对百科全书、科学公式、历史事件等事实性强的内容,与Wikidata等权威知识库进行交叉比对,事实校验覆盖率>80%,重点覆盖核心事实内容。

(2)错误内容剔除规则

错误内容剔除规则明确:确认为事实错误且无法修正的内容,坚决剔除,避免误导模型;存在争议的内容标记为“待核实”,进行降权处理,暂不纳入核心训练语料。

(3)专业内容专家终审要求

专业内容专家终审有三项要求:医疗、法律、金融等高风险领域数据,必须经过领域专家抽样终审;专家终审抽样率>5%,确保高风险数据质量;终审结果需由专家签字确认,形成终审记录,确保可追溯。

(4)验收指标

事实校验环节的验收指标为:事实准确率>98%,核心事实无错误;错误检出率>90%,错误内容得到有效剔除;专家终审完成率100%,高风险数据全部经过终审。

2.3.7切片环节:语义完整与模型适配

切片环节需基于语义完整性进行操作,适配模型上下文窗口,避免语义断裂,保障模型学习效果。

(1)语义切片规范

语义切片需基于段落、标点或语义转折点进行切分,严禁在句子中间强行截断,每个切片需保留完整的语义单元,确保模型能理解上下文逻辑。

(2)模型窗口适配要求

模型窗口适配有两项要求:切片长度略小于模型最大上下文窗口,预留10%的空间给特殊Token,避免溢出;设置10%-20%的切片重叠度(Overlap),保持上下文连贯性,帮助模型理解语义关联。

(3)语义完整性保障规则

语义完整性保障需利用语义边界检测算法辅助切片,确保切片语义完整,同时严格避免“断头句”,杜绝语义断裂。

(4)验收指标

切片环节的验收指标为:语义完整率>98%,切片无语义断裂;切片重叠度符合10%-20%的设定要求;断头句率<1%,无明显语义缺陷。

2.3.8配比组装环节:五维刚性配比与分布均衡

配比组装环节基于五维维度进行语料配比,确保数据分布均衡,避免模型能力偏科,支撑模型通用能力。

(1)五维刚性配比规则

五维刚性配比规则涵盖五个维度:在领域分布上,通用、科技、人文、代码、数学等领域按预设比例配置,兼顾全面性与针对性;在语言分布上,中文、英文及其他语种按企业战略目标配置,适配目标应用场景;在模态分布上,以文本数据为主,搭配适量图文对数据,支撑多模态学习;在时间分布上,保证近期数据占比,兼顾历史经典数据,确保模型知识时效性与完整性;在质量分布上,高质精读数据与海量泛读数据按比例混合,平衡模型精度与泛化能力。

(2)分布均衡性校验标准

分布均衡性校验采用卡方检验等统计方法,验证数据分布是否符合预设要求,数据分布偏离度<5%,确保分布均衡,无严重偏斜。

(3)领域分布管控红线

领域分布管控有两条红线:单一领域数据占比不得超过40%,防止模型能力偏科;代码数据占比建议5%-15%,数学数据占比建议3%-8%,适配模型逻辑推理能力需求。

(4)验收指标

配比组装环节的验收指标为:数据分布偏离度<5%,符合均衡要求;单一领域占比<40%,无能力偏科风险;五维配比达标率100%,严格遵循刚性规则。

2.4多模态预训练数据专项处理执行细则

针对多模态数据特性,制定专属处理规范,确保模态间语义一致,提升多模态模型能力。

2.4.1图文配对处理

图文配对处理需利用BLIP等专业模型生成图像描述,确保描述准确性,同时计算图文相似度,剔除描述与图像不匹配的噪声对,相似度阈值需大于0.7。

2.4.2 OCR增强处理

OCR增强处理需对包含文字的图片进行OCR识别,提取文字信息,再将识别的文字信息作为额外Token输入模型,增强多模态理解能力。

2.4.3验收指标

多模态预训练数据专项处理的验收指标为:图文配对准确率>85%,配对逻辑一致;OCR识别准确率>95%,文字提取无明显错误;多模态语义一致性>85%,符合跨模态融合要求。

2.5伦理/反例/偏见/记忆安全专项处理执行细则

全流程嵌入伦理治理,管控偏见与记忆安全风险,确保模型输出合规、公正,符合人类价值观。

2.5.1伦理筛查

伦理筛查需使用多标签分类器对全量语料进行扫描,识别高风险伦理内容,对高风险内容不直接删除,采用降权处理或转化为负样本,引导模型正确认知。

2.5.2偏见平衡

偏见平衡需统计性别、职业等词汇的共现频率,识别刻板印象严重的语料,对刻板印象语料进行降采样处理,平衡各群体代表性,要求群体代表性差异系数<0.2,确保无明显偏见。

2.5.3记忆安全

记忆安全需对包含大量个人隐私的论坛帖子、泄露数据库等整库剔除,不纳入训练集,同时建立敏感数据黑名单,持续更新,从源头杜绝记忆泄露风险。

2.5.4验收指标

本专项处理的验收指标为:伦理样本覆盖率100%,无遗漏的高风险伦理内容;偏见检测覆盖率>90%,刻板印象得到有效管控;敏感数据剔除率100%,无敏感数据混入训练集。

2.6预训练数据质检与版本冻结执行规范

建立多级质检体系,确保数据质量达标,通过版本冻结实现数据可追溯、不可篡改,支撑模型复现。

2.6.1多级质检

多级质检包含三个层面:自动化脚本全检,覆盖所有数据,快速排查基础质量问题;人工随机抽检,抽样率1%,重点核查自动化质检无法覆盖的细节问题;专家专项复审,高风险领域数据100%复审,确保无质量隐患。

2.6.2版本冻结

版本冻结需在质检通过后,生成不可变的Dataset Manifest文件,记录所有数据明细,同时详细记录所有文件的Hash值与处理参数,确保数据可追溯、可复现,最终正式封版,禁止任何未经授权的修改,确保证书数据一致性。

2.6.3验收指标

本环节的验收指标为:质检覆盖率100%,无未质检数据;版本信息完整率100%,Hash值与处理参数记录无误;封版合规率100%,无违规修改情况。

2.7本阶段核心红线与避坑指南

明确预训练阶段核心红线,总结常见误区与正确做法,规避数据治理风险,具体内容如下:

(1)核心红线

预训练阶段的核心红线有三条:第一条是无授权采集数据,违反该红线会引发法律风险,导致模型下架、企业合规处罚,检测方式为定期开展授权台账检查,核查数据来源合规性;第二条是PII数据未脱敏,违反后会造成隐私泄露,触发监管处罚,损害用户信任,检测方式为全量数据脱敏率扫描,重点核查高风险数据;第三条是过度清洗导致模型认知边界缺失,违反后会使模型泛化能力下降,无法适配真实复杂场景,检测方式为边界样本保留率检查,核查过度清洗违规情况。

(2)避坑指南

常见的误区及对应正确做法、核心目的如下:常见误区之一是单一来源依赖,正确做法是多源采集数据,控制单源占比<30%,核心目的是防范数据投毒、避免数据偏斜,提升数据多样性;常见误区之二是固定长度切片,正确做法是基于语义完整性进行切片,适配模型窗口,核心目的是避免语义断裂,确保模型能理解上下文逻辑;常见误区之三是忽视代码与数学数据质量,正确做法是对代码、数学数据进行专项质检,确保准确性,核心目的是提升模型逻辑推理与代码处理能力,避免能力短板。

第三章 模型后训练阶段数据治理与处理执行规范

3.1阶段核心目标与处理总原则

3.1.1核心目标

后训练阶段的核心目标有三点:一是在预训练基座模型能力之上,精准注入特定领域知识,提升模型场景适配性;二是规范模型指令遵循行为,确保模型能准确理解并执行用户指令;三是对齐人类价值观,保障模型输出安全、合规、公正。

3.1.2处理总原则

该阶段数据处理需遵循三项总原则,分别是精准(Precision)、安全(Safety)和兼容(Compatibility)。其中,精准要求数据质量高,监督信号明确,针对性解决模型短板;安全要求伦理合规,无风险内容,避免模型输出有害信息;兼容要求与基座模型能力兼容,避免灾难性遗忘,保留通用能力。

3.2持续预训练(增量预训练)场景数据处理执行规范

3.2.1场景核心目标与处理总原则

(1)核心目标

增量预训练场景的核心目标是向基座模型注入特定领域(如医疗、法律、金融)知识或新语言,提升场景专项能力,同时最小化对基座模型通用能力的遗忘,实现“专项提升+通用保留”的平衡。

(2)处理总原则

本场景的处理总原则包括三点:领域专注,数据聚焦目标领域,避免无关数据干扰,提升训练效率;知识准确,领域知识需经过严格校验,确保无错误,避免误导模型;分布兼容,增量数据与基座训练数据分布兼容,降低遗忘风险。

3.2.2增量数据专属处理流程

增量预训练数据处理需兼顾领域针对性与兼容性,具体流程为:采集 → 格式转化 → 清洗 → 脱敏 → 去重 → 事实校验 → 领域反例/边界样本加工 → 切片 → 先验兼容性校验 → 配比组装 → 质检。

3.2.3各处理动作执行细则与专属要求

各处理动作的专属要求及对应验收指标如下:在采集环节,专属要求是聚焦目标领域核心期刊、教材、法规、专利等高信源数据,确保领域针对性,验收指标为信源合规率100%,领域相关性>95%;在清洗环节,专属要求是保留领域特有的术语与表达习惯,避免过度清洗导致领域知识流失,验收指标为领域特色保留率>95%,低质内容剔除率>90%;在兼容性校验环节,专属要求是与基座训练数据进行语义分布对比(采用KL散度),确保分布兼容,验收指标为KL散度<0.3(行业常规预设阈值),分布兼容性达标。

3.2.4灾难性遗忘防控核心处理要求

(1)回放机制

回放机制要求在增量数据集中混入10%-20%的基座通用语料(Replay Buffer),维持模型通用能力,且通用语料需与增量数据分布兼容,避免干扰领域知识学习。

(2)配比策略

配比策略需严格控制增量数据总量,避免“小数据覆盖大数据”,防止遗忘基座能力,同时确保增量数据与通用语料配比合理,优先保障通用能力不流失。

(3)评估要求

评估要求训练后评估基座模型核心能力保持率,确保无明显遗忘,基座能力保持率目标>95%,核心通用能力不下降。

3.2.5核心红线与避坑指南

(1)核心红线

本场景的核心红线有两条:严禁引入错误领域知识,避免模型输出错误信息;严禁完全剔除通用语料,防止模型灾难性遗忘,丧失通用能力。

(2)避坑指南

常见误区及正确做法如下:误区一是忽视领域知识的时效性,正确做法是建立领域知识时效性更新机制,定期剔除过期内容;误区二是未做遗忘评估直接上线,正确做法是训练后严格评估基座能力保持率,达标后方可上线。

3.3监督微调(SFT)场景数据处理执行规范

3.3.1场景核心目标与处理总原则

(1)核心目标

SFT场景的核心目标是教会模型准确理解用户指令意图,提升指令遵循能力,同时引导模型输出结构规范、逻辑清晰、事实准确的回答,提升输出质量。

(2)处理总原则

本场景的处理总原则包括三点:指令清晰,指令表述明确、无歧义,确保模型能准确理解需求;回复高质量,回复内容准确、完整、流畅,符合场景需求;配对严谨,指令与回复一一对应,无错配、漏配情况。

3.3.2指令数据专属处理流程

SFT指令数据处理需注重指令与回复的配对质量,具体流程为:指令集设计 → 样本采集 → 格式转化 → 清洗 → 标注 → 交叉校验 → 事实校验 → 伦理/边界样本加工 → 切片 → 质检 → 配比组装 → 版本冻结。

3.3.3各处理动作执行细则与专属要求

(1)标注环节

标注环节有三项要求:一是规范,制定详细的Instruction-Response编写指南,明确语气、格式、长度等要求,确保标注统一;二是培训,标注人员需经过严格培训与考试,持证上岗,确保标注质量;三是校验,实行“双人盲标+专家仲裁”机制,标注一致性达标后,方可进入下一环节。

(2)切片环节

切片环节需保持“指令-思考过程-回答”的完整性,严禁拆分,确保模型学习完整的指令响应逻辑,同时切片长度适配模型窗口,避免溢出,保留完整语义。

(3)配比环节

配比环节有三项要求:一是场景覆盖,全面覆盖写作、问答、代码、推理、角色扮演等核心场景,确保模型适配多样化需求;二是刚性配比,正向样本:负向样本:边界样本 ≈ 7:2:1,平衡模型学习方向;三是特殊样本,必须包含足够的“拒绝指令”样本(如拒绝恶意请求、违规指令、隐私查询等),明确模型拒绝边界,引导模型做出合规回应。

(4)验收指标

本环节的验收指标为:指令与回复配对准确率100%,无错配、漏配情况;标注一致性≥95%,符合标注规范要求;场景覆盖率≥90%,覆盖核心应用场景;“拒绝指令”样本占比≥5%,确保模型明确拒绝边界。

3.3.4 SFT数据质量管控核心要求

SFT数据质量管控有四项核心要求:避免指令模糊,严禁出现歧义、多义指令,确保每个指令的意图唯一,降低模型理解成本;控制回复冗余,回复内容需精准匹配指令需求,避免无关信息堆砌,提升模型响应效率;事实一致性,回复内容需与事实相符,严禁出现虚假信息,需经过事实校验环节确认;风格统一,同一类型指令的回复风格、格式保持一致,确保模型输出的规范性。

3.3.5核心红线与避坑指南

(1)核心红线

SFT场景的核心红线有三条:严禁指令与回复错配,避免模型学习错误的指令响应逻辑;严禁标注质量不达标(标注一致性<95%)的数据进入训练环节;严禁缺失“拒绝指令”样本,防止模型对违规请求无底线响应。

(2)避坑指南

常见误区及正确做法如下:误区一是指令设计过于简单,无法覆盖复杂场景,正确做法是设计多维度、多场景指令,包含简单指令与复杂指令,提升模型适配性;误区二是回复只追求长度,忽视准确性,正确做法是以“准确、简洁、规范”为核心,优先保障回复质量,而非长度;误区三是忽视标注一致性校验,正确做法是严格执行“双人盲标+专家仲裁”,定期开展标注质量复盘,及时修正偏差。

3.4对齐(RLHF)场景数据处理执行规范

3.4.1场景核心目标与处理总原则

(1)核心目标

RLHF场景的核心目标有三点:一是对齐人类价值观与偏好,确保模型输出符合人类伦理、审美与需求导向;二是强化模型安全边界,杜绝有害、不当输出,提升模型可信度;三是优化模型响应质量,使输出更贴合人类预期,提升用户体验。

(2)处理总原则

本场景的处理总原则包括三点:偏好真实,人类反馈数据需真实反映人类偏好,严禁伪造反馈标签;标注规范,反馈标注需统一标准,确保标注一致性,避免偏好歧义;安全优先,优先筛选安全、合规的反馈样本,强化模型安全导向。

3.4.2对齐数据专属处理流程

RLHF数据处理需聚焦人类反馈质量,具体流程为:人类反馈采集 → 反馈标注 → 标注校验 → 偏好排序 → 清洗去重 → 伦理筛查 → 质量分级 → 配比组装 → 质检 → 版本冻结。

3.4.3各处理动作执行细则与专属要求

(1)人类反馈采集

人类反馈采集有三项要求:采集主体需选择符合目标用户画像的标注人员,确保反馈的代表性;采集规范需明确反馈场景与评价维度(如相关性、准确性、安全性、流畅性),避免反馈偏差;反馈形式采用pairwise对比(两两对比选优)或评分制,确保反馈信号明确。

(2)反馈标注与校验

反馈标注与校验需遵循三项要求:标注规范需制定详细的反馈标注指南,明确各评分等级、对比标准,确保标注统一;校验机制实行“双人标注+专家复核”,标注一致性≥90%方可进入下一环节;异常处理需对标注分歧较大的样本,由专家仲裁确定最终标签,避免无效反馈。

(3)偏好排序与质量分级

偏好排序与质量分级的要求为:基于人类反馈,对模型不同输出进行排序,形成明确的偏好梯度;将反馈样本分为优质、合格、待优化三级,优质样本优先用于训练。

(4)验收指标

本环节的验收指标为:反馈标注一致性≥90%,无明显标注偏差;优质样本占比≥60%,确保训练效果;反馈真实性100%,无伪造反馈样本。

3.4.4核心红线与避坑指南

(1)核心红线

RLHF场景的核心红线有三条:严禁伪造人类反馈数据,避免模型学习错误的人类偏好;严禁标注一致性<90%的数据进入训练环节,确保反馈信号有效;严禁引入包含有害、违规内容的反馈样本,防止模型安全边界弱化。

(2)避坑指南

常见误区及正确做法如下:误区一是反馈样本单一,无法覆盖多样场景,正确做法是采集多场景、多用户画像的反馈,确保偏好的全面性;误区二是忽视反馈标注一致性,正确做法是定期开展标注培训与复盘,强化标注规范,提升一致性;误区三是过度依赖优质样本,忽视边界样本,正确做法是合理配比优质、合格样本,保留适量边界样本,提升模型鲁棒性。